Cuando estamos frente a un video, muchas veces nos surge la duda de si lo que vemos o escuchamos es real y rápidamente aplicamos la lógica de buscar el origen o fuente para verificar la información, pero ¿qué sucede cuando esa fuente incluye un deepfake en el que no seamos capaces de diferenciar de si lo que vemos es real o falso?

¿Cómo detectar un deepfake?

De acuerdo con un estudio reciente publicado en Proceedings of the National Academy of Sciences USA, se ha vuelto cada vez más difícil distinguir entre rostros generados sintéticamente y rostros orgánicos, ya que las caras creadas sintéticamente son fotorrealistas y se consideran casi indistinguibles de las reales, siendo cada vez más confiables.

Aunque la tarea de diferenciarlos es cada vez más desafiante, aún existen detalles a los cuales se debe prestar atención para identificar posibles indicadores de falsificación.

I. Parpadeo de ojos

El parpadeo de los ojos es un proceso natural, la mayoría de las personas realizan esta acción aproximadamente cada 2-8 segundos, con una duración de 1 a 4 décimas de segundo por cada uno. Sin embargo, los algoritmos de deepFake no pueden replicar la velocidad de parpadeo humano, lo cual es evidente al observar la frecuencia en los sujetos de los videos generados por estos algoritmos.

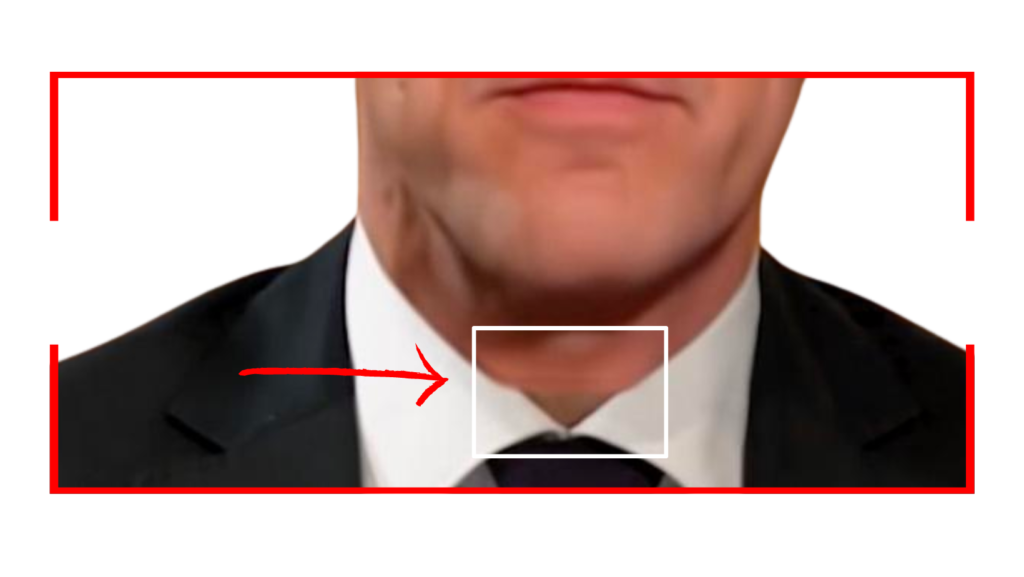

II. Cuello y rostro

En los deepfake, la mayoría de las veces sustituye la cara de una persona, y los cambios en el cuerpo requieren un mayor esfuerzo. Por lo tanto, la postura y las expresiones faciales de la persona en el video pueden no coincidir completamente.

Si se observan características diferentes en el cuerpo, como tatuajes, músculos pronunciados o un color de piel distinto, puede ser una señal de que el video es falso y ha sido manipulado mediante la esta tecnología.

III. Duración del clip

La mayoría de los deepfakes que circulan en la web, suelen tener solo unos segundos de duración, quienes crean estos videos optan por clips cortos para minimizar la posibilidad de ser detectados, ya que puede ser más difícil verificar en un tiempo limitado.

IV. Fuente de la grabación

Es fundamental en este contexto rastrear la fuente de la grabación, es decir, la persona que compartió inicialmente el video deepfake. Esto puede ayudarnos a entender el contexto de la publicación y verificar si el material original era más detallado de lo que parece.

V. Sincronización de labios

Aunque los deepfakes pueden parecer realistas a simple vista, prestar atención a los detalles, como la apariencia de la boca, puede ser una forma útil de identificar posibles falsificaciones. Por ejemplo, un desenfoque en el interior de la boca puede ser una señal de que la imagen es posiblemente falsa. La Inteligencia Artificial todavía tiene dificultades para representar adecuadamente los dientes, la lengua y la cavidad bucal al hablar.

Es esencial tener precaución y verificar siempre la información que encontramos en línea. Los deepfakes son solo un ejemplo de cómo la tecnología puede utilizarse para generar contenidos falsos y engañosos. Las Fake news son un fenómeno que puede propagarse rápidamente, generando controversias y desinformación. Por lo tanto, es importante ser críticos y buscar fuentes confiables antes